如何用 prompt(提示詞)和 AI 助理溝通、協作已成為許多人工作的日常。但隨著交給 AI 的任務及資料量劇增,工作者及企業可能常會遇到一個令人困惑的問題:

明明給了充足的資料、使用了 RAG 技術,AI 給的答案卻仍然不夠精準,甚至發生錯誤。

排除使用的 AI 模型能力不足、資料品質不佳、prompt 寫得不夠清楚,近期的研究發現,你面臨的可能是一個反直覺的因素:AI 也可能分心而沒仔細看完你給的資訊!

本篇 Aiworks 將告訴你,prompt 中的資訊結構和排列順序如何影響 AI 產出品質,並運用「壽司結構」等進階技巧設計高品質提示詞,讓 AI 更容易抓住重點!

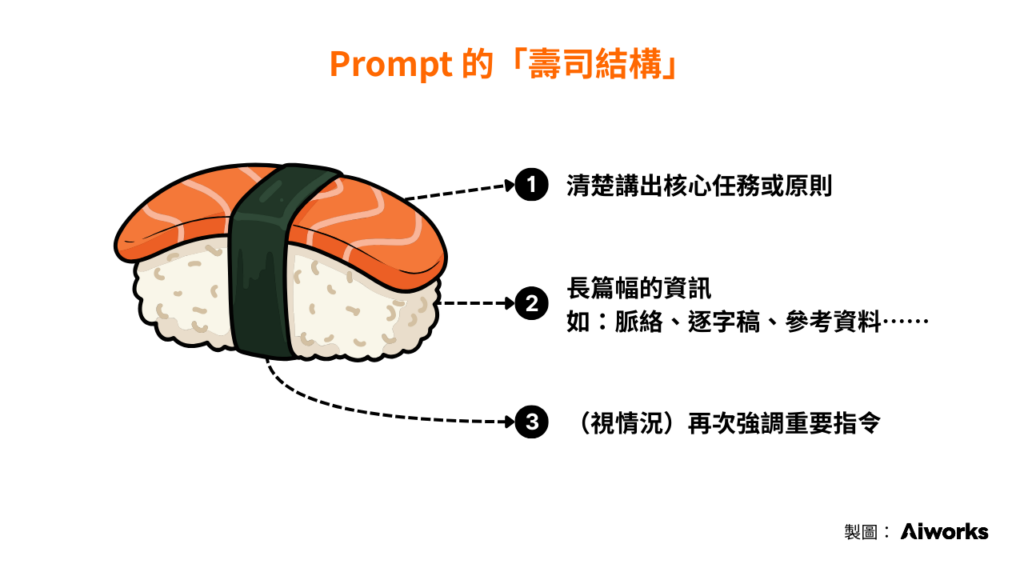

壽司結構:將最重要的資訊放在 prompt 的最上層

一個好的 prompt,就像一貫握壽司:

| 最上層(生魚片、主料) | 清楚講出核心任務或原則 |

| 中層(醋飯) | 長篇幅的文字如:脈絡、逐字稿、參考資料⋯⋯ |

| 底層或外層(海苔) | (視情況)再次強調重要指令 |

就像壽司不能沒有醋飯一樣,脈絡及參考資料等都是不可或缺的資訊,而將重點放在開頭,並視情況於結尾再次提醒,能顯著降低模型誤讀風險。

範例一:請 AI 總結長篇會議記錄

| ❌ 錯誤寫法 | ✅ 推薦寫法 |

| 以下是今天的會議逐字稿: [5000 字今天會議逐字稿] 請幫我總結行銷部的預算決議。 以下是去年的參考資料: [2000 字去年會議逐字稿] | 請根據以下資訊,總結行銷部門的預算決議,並列點說明: 今天的會議逐字稿: [5000 字今天會議逐字稿] 去年參考資料: [2000 字去年會議逐字稿] 提醒:重點在行銷部門的預算數字,請列點說明。 |

範例二:請 AI 根據客服規範回覆

| ❌ 錯誤寫法 | ✅ 推薦寫法 |

| 你是一位專業客服人員,請回答客戶提問: [500 字客戶提問] 注意:請勿主動承諾客戶退款! 以下是產品資訊: * 產品資訊 1 * 產品資訊 2 ⋯⋯ * 產品資訊 50 | 【角色】:你是一位專業客服人員。 【核心原則】:請勿主動承諾客戶退款! 以下為客戶提問: [500 字客戶提問] 以下是產品資訊: * 產品資訊 1 * 產品資訊 2 ⋯⋯ * 產品資訊 50 注意:請勿主動承諾客戶退款! |

為什麼 AI 會漏看關鍵資訊?解析大型語言模型(LLM)的注意力機制

AI 的「序位效應」:為什麼放中間的提示詞容易被遺忘?

生成式 AI 的核心為大型語言模型(LLM, Large Language Model),而 LLM 則是建立在 Transformer 架構之上,所有的內容(context,又譯文本、上下文)都會被拆解成一個一個 token 進行解碼和編碼。而理想上 Transformer 會將注意力平均分配在內容中的每一個 token 上。

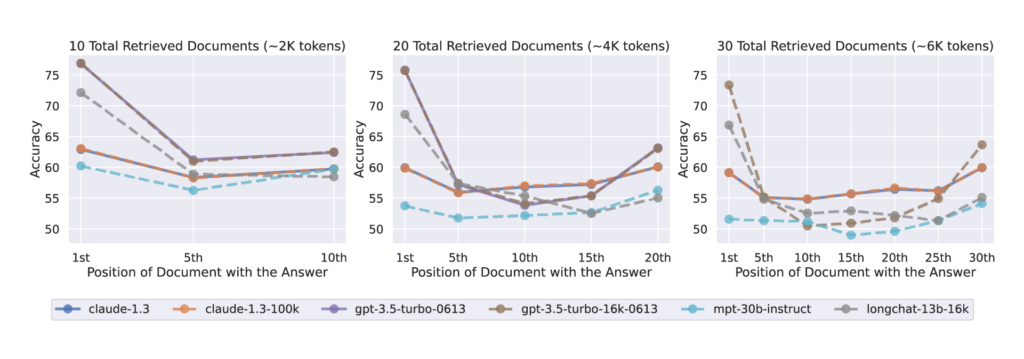

但根據史丹佛大學研究團隊發表的《Lost in the Middle: How Language Models Use Long Contexts》指出,在提供模型內容時:

- 若重要資訊放在最開頭,準確率高。

- 若重要資訊放在最結尾,準確率也高。

- 若重要資訊放在中間,隨著文本越長,準確率明顯下降。

(source: Figure 5, Lost in the Middle: How Language Models Use Long Contexts, 2023)

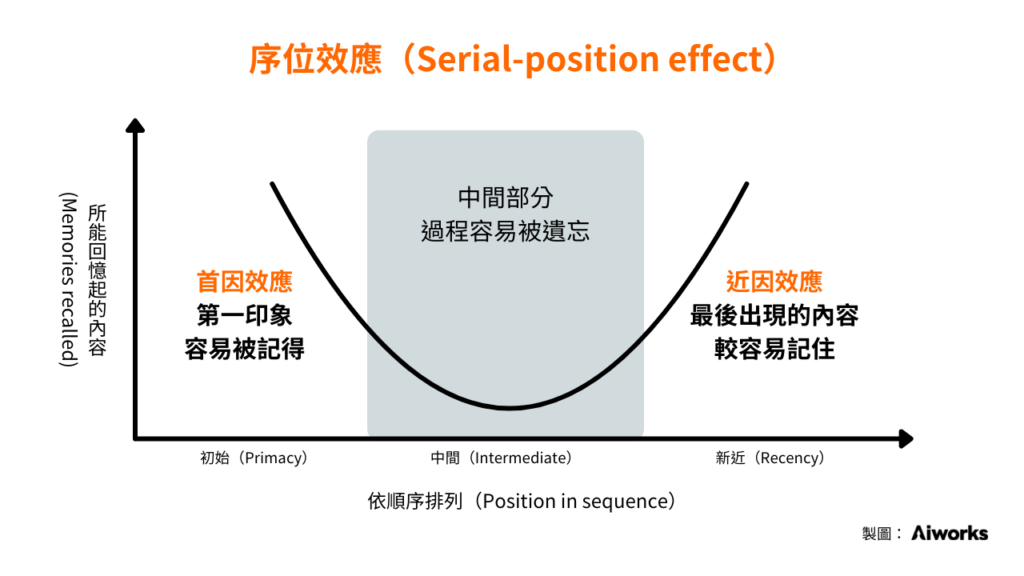

而這正與人類認知心理學中序位效應(Serial-position effect)的首因效應(Primacy effect)與近因效應(Recency effect)不謀而合:

- 首因效應(Primacy Effect): 我們容易記住第一印象,也就是最先看到的資訊

- 近因效應(Recency Effect): 我們容易記住剛剛發生的事,也就是最後看到的資訊

資訊越多越好?破解 AI 閱讀長文本的理解限制

根據該報告,AI 的注意力出現近似於「序位效應」的原因可能是:

- 閱讀順序的物理限制:在內容拆解的過程中,AI 依然是由左至右、由上至下地單向閱讀,當它在預測或處理當下這個字時,只能把注意力放在「前面已經出現過」的字詞上。

- 注意力被雜訊稀釋:隨著內容量增加,雖然包含了正確解答的機率增加,但也同時大幅增加了 AI 必須處理的「雜訊」,讓注意力被稀釋,甚至成為負擔。

可以想像將模型擁有一盞大小固定的聚光燈。當模型生成每一個字時,就會回頭掃視整段使用者提供的上下文,但它只看得見被光打亮的字。

- 聚光燈只能單向掃描,而前面已經出現過的字,模型會認為它更重要。

- 當內容很短時,聚光燈可以照亮每一個字;但當內容很長時,聚光燈無法讓內容中所有的字都一樣亮。

日常可立即使用的 3 個 Prompt 心法

最後,讓我們把「壽司結構」的概念轉化為馬上就能用的 3 個心法。

心法 1:任務前置,資料後置

先明確說明任務,再貼參考資料。

下方為這一期即將發佈的 podcast 逐字稿,請以提升點擊率為目標,由「具吸引力」到「專業正式」,提供我 5 個版本的主旨與預覽文字。

```

[逐字稿內容]

```心法 2:角色設定放最前面

若希望模型扮演特定角色,務必置於 Prompt 的最前面。

你是一位社群貼文(SNS)小編,活躍於 Facebook 與 Instagram,來源內為你過往已公開發布的社群貼文文案。

請在每次回應遵循以下規則:

⋯⋯心法 3:縮短參考資料篇幅

如果在 100 頁的 PDF 中,只需要針對第 50 頁的註腳及圖表內容提問,建議先抽取該段文字及圖表,單獨交給 AI,避免讓模型在 100 頁 PDF 中大海撈針。

閱讀下方內容及附圖,並解釋其意義:

```

[註腳內容]

```好的 Prompt 設計,就是你的 AI 管理能力

AI 雖然強大,但它和人類一樣,注意力是有限的。

在內容及文本劇增時,資訊排列方式往往比資料量更重要。

透過如「壽司結構」簡單的 Prompt 結構設計,便可以有效降低模型誤讀的風險,提升回答準確率。

在 AI 協作流程中,競爭力並不只是來自於使用的模型與工具,而是如何安排資料,讓 AI 更容易理解重點。

📩 想為你的組織打造 AI 協作能力?

Aiworks 提供企業內訓、客製化培訓與實作工作坊,協助各產業團隊規劃生成式 AI 的導入與應用策略。

▼ 聯絡我們|規劃你的 AI 實戰課程,讓轉型真正落地 ▼

(若表單未正常顯示,請點擊此連結進入表單填寫頁面)

推薦延伸閱讀

▶︎ 為什麼你的 AI 看不懂 Excel?從 AI 閱讀邏輯看懂 Markdown 的關鍵角色

▶︎ 不只是筆記工具!教你用 NotebookLM 輕鬆打造 AI 客服助理

▶︎ 你的 ChatGPT 安全嗎?使用 AI 工具必知的 10 個安全檢核

▶︎ 推理模型是什麼?從 GPT-4o 到 o3,一次看懂 ChatGPT 模型差異與應用場景

▶︎ 為什麼 95% 的企業 AI 導入會失敗?MIT 報告揭露 AI 鴻溝與低 ROI 真相