員工告訴你,AI 工具最近感覺變差了,回答變短、容易忘記前面說過的事、輸出品質不如預期。你不確定該怎麼判斷:是員工的使用方式出了問題?是工具本身的問題?還是期待值提高了?

這種模糊感,在 AI 工具大規模推廣之後幾乎必然出現。它不是個別員工的主觀感受落差,而是一個結構性的盲點,因為大多數組織在推廣 AI 工具時,從來沒有建立一套機制,可以回答「品質由誰負責、出了問題要怎麼判斷」這個問題。

本篇 Aiworks 將從 Harness 這個概念出發,說明 AI 工具背後那一層持續影響輸出品質的控制結構,以及組織要如何從被動承受廠商的調整,走向主動駕馭。

什麼是 Harness:AI Agent 架構中決定輸出品質的控制層

LangChain 在 2026 年 3 月的文章中給出了一個清晰的架構定義:Agent = Model + Harness。

模型(Model)是 AI 的推理引擎,負責理解指令、生成回應。這一層的能力正快速提升,各家廠商的差距也在縮小,模型本身越來越趨向商品化。

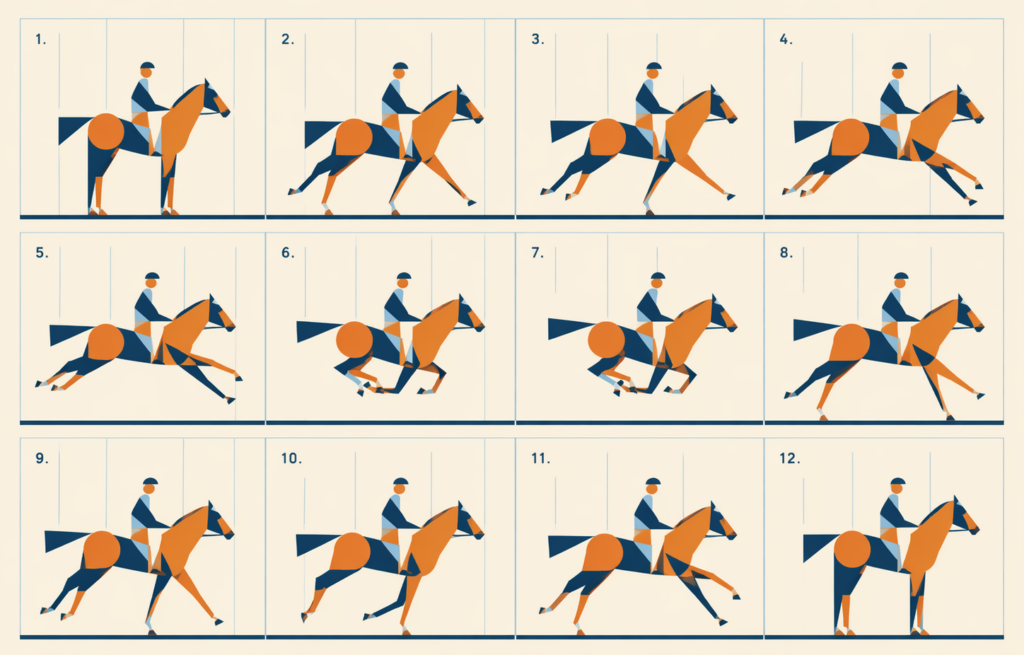

Harness 這個字本身就是馬具的意思,如馬鞍與韁繩。強大的 AI 就像一匹具有強大力量的馬,馬的力量決定了能走多遠,但懂得駕馭的人,才決定了實際往哪裡走。

Harness 是包在模型外層的控制結構,決定 AI 在具體使用情境中的實際行為。它管理兩個層面:

行為定義層:AI 被告知什麼、被允許做什麼

- 系統提示詞(System Prompt)與任務指令

- 使用規範與角色設定

- 每次對話中 AI 能存取的上下文範圍

品質保障層:出錯時如何被偵測與修正

- 自動驗證機制

- 異常回報流程

- 行為邊界的強制執行

當你選定一個 AI 工具,你接受的不只是模型本身,而是廠商對這整套 Harness 結構的所有決定,包含:

- 預設行為與思考深度的設定

- context 的管理方式

- 每次版本更新帶來的調整

這些決定持續在進行,通常不會主動通知你,但你拿到的輸出品質,隨時都受它們影響。

從 Anthropic 事後檢討報告看 3 個 Harness 問題如何影響 AI 工作品質

Harness 的問題難以被察覺,因為症狀與根因之間的距離很遠。你知道輸出品質變了,但你看不見哪一層出了問題,也沒有工具可以定位原因。

2026 年 4 月,Anthropic 公開了一份 Claude Code 的品質問題事後報告。這份報告讓外界看見了一件平時完全不可見的事:廠商的 Harness 決策,是如何在不被察覺的情況下,持續影響使用者拿到的結果。

報告中三個問題的影響範圍橫跨數週、涉及不同用戶群:

- 推理深度預設值被調低:模型輸出品質下降,但用戶不知道這個設定已經變了

- Context 管理出現問題:AI 在同一段對話中逐漸「忘記」自己的決策脈絡,造成重複、健忘、行為不一致

- 系統提示詞加入字數限制:在多個設定交互影響下,導致輸出品質下降

三個問題表面上看起來是難以定位的品質退化,但追查下去,問題的根源全部發生在 Harness 層,模型本身完全沒有改變,透過 API 直接使用模型的開發者也完全未受影響。

這份報告真正說明的是一件結構性的事實:即使是持續投入大量資源管理 Harness 的頂級廠商,這一層仍然需要被持續維護,而且很容易在不被察覺的情況下影響工作品質。Harness 不是一次設定完就固定的結構,它是一個需要持續被主動管理的層次。

AI 工具全面推廣後,企業端的 Harness 管理責任

實際上,每一個 AI 工具都存在兩層 Harness。

第一層是廠商建立的 Builder Harness,決定了工具的基本行為。系統提示詞的設計、內容檢索的機制、安全邊界的設定。這一層由廠商持續維護和調整,組織無法直接介入,但它的每一次變動都在影響你的工作輸出,前面的 Postmortem 案例揭示的正是這種影響。

第二層是組織需要自己建立的 User Harness,套在廠商 Harness 的外層。這一層有兩個目標:提高 AI 工具在組織使用情境下一次就做對的機率,以及在出問題時有機制可以偵測和修正,而不是等到員工反映才知道出了什麼狀況。

試用階段,這兩層的區分對組織幾乎沒有感知。個別員工對工具的理解深淺不同,輸出品質本來就參差不齊,很難分辨問題出在哪一層。

一旦開始跨部門推廣,讓更多員工依賴 AI 工具做決策、產出報告、處理客戶溝通,這個區分就變得關鍵。廠商的 Builder Harness 決策開始影響組織整體的工作品質,而你的 User Harness 若沒有建立,沒有人知道問題從哪裡來,也沒有辦法系統性地處理。

User Harness 的實際樣貌不是技術建設,而是工作流程層面的管理結構:這個工具應該用在哪些場景、用什麼方式提問、輸出品質的標準是什麼、員工發現問題時要往哪裡回報。

Aiworks 觀點:Harness 治理能力是 AI 導入的下一個成熟度門檻

回到馬具的比喻:廠商替你備好了馬,但馬要走哪條路、走多快、在哪裡停下來,是你的組織必須決定的事。

OpenAI 在記錄自家 Harness 實作後,得出了這樣的結論:

“Our most difficult challenges now center on designing environments, feedback loops, and control systems.”

「我們面臨的最困難挑戰,集中在設計環境、回饋迴路和控制系統。」

即使是頂級 AI 廠商,也把 Harness 管理視為最核心的工程挑戰,而不是工具選完就可以不管的配套。對企業端來說,這個挑戰的性質相同,只是落點不同:不是技術建設,而是組織能力的建立。

沒有品質感知機制的推廣,是一種沒有儀表板的飛行。員工回饋品質變差,你沒有數據可以判斷;工具改版帶來變化,你沒有基準可以比較;某個部門的使用方式出現偏差,你沒有機制可以及早發現。

Aiworks 認為,Harness 能力是一種需要被設計和維護的組織基礎設施,而不是導入專案完成後就可以擱置的配套措施。它包含:

- 使用規範的持續更新

- 提示詞品質的標準化

- 回饋管道的設計

- 對廠商版本變動的追蹤習慣

評估 AI 導入成熟度,不應該只看「有多少人在用這個工具」,而是要問:組織有沒有能力感知這個工具正在做什麼決定,以及那些決定有沒有在變?前者是採用率,後者才是治理能力 (Governance)。

廠商負責維護他們的 Harness,但你的組織負責建立自己的。這兩件事缺一不可,而且第二件事,目前大多數企業都還沒有開始。

一個簡單的自我評估:如果你的組織明天收到一封 AI 工具廠商的「品質問題公告」,你有辦法評估這個問題對你的工作流程影響有多大嗎?如果答案是不確定,那代表你現在缺少的,不是更多的 AI 工具,而是駕馭這些工具的組織能力。

📩 想為你的組織打造 AI 協作能力?

Aiworks 提供企業內訓、客製化培訓與實作工作坊,協助各產業團隊規劃生成式 AI 的導入與應用策略。

▼ 聯絡我們|規劃你的 AI 實戰課程,讓轉型真正落地 ▼

(若表單未正常顯示,請點擊此連結進入表單填寫頁面)

推薦延伸閱讀

▶︎ 被取代、被重組,還是因 AI 擴張?OpenAI 最新報告的 6 個關鍵發現

▶︎ 什麼是 AI Agent?一窺 2025 最重要企業 AI 應用趨勢

▶︎ 什麼是 Agent Skills?為 AI 打造一本企業級任務攻略

▶︎ 你的 ChatGPT 安全嗎?使用 AI 工具必知的 10 個安全檢核

▶︎ 從醫療 AI 策略看企業合規:AI 如何踏入高度監管產業?

參考資料

- Harness Engineering:有時候語言模型不是不夠聰明,只是沒有人類好好引導|李宏毅教授

- The Anatomy of an Agent Harness|LangChain

- Harness engineering for coding agent users|Birgitta Böckeler

- Harness engineering: leveraging Codex in an agent-first world|OpenAI

- Bui, N. D. Q. (2026). Building effective AI coding agents for the terminal: Scaffolding, harness, context engineering, and lessons learned. arXiv. https://doi.org/10.48550/arXiv.2603.05344