你上次打開 AI,問了什麼問題?

有沒有一種時刻,你想找一個可以說真話的對象?職涯上的選擇、某件事的對錯判斷、不知道怎麼跟某人開口⋯⋯帶著「我真的不確定該怎麼辦」去問 AI,然後等它給一個方向。

如果有,你不是少數人。Anthropic 近期分析了 100 萬筆真實對話,剖析了人是如何向 AI 諮詢意見,以及這類對話的規模有多大。

本篇 Aiworks 將從這份研究出發,帶你看人如何向 AI 尋求指引,AI 又如何在過程中可能給出討好而非誠實的回應,以及這件事在企業推動 AI 導入時值得認真看待的原因。

人向 AI 尋求個人指引時,問的是什麼?

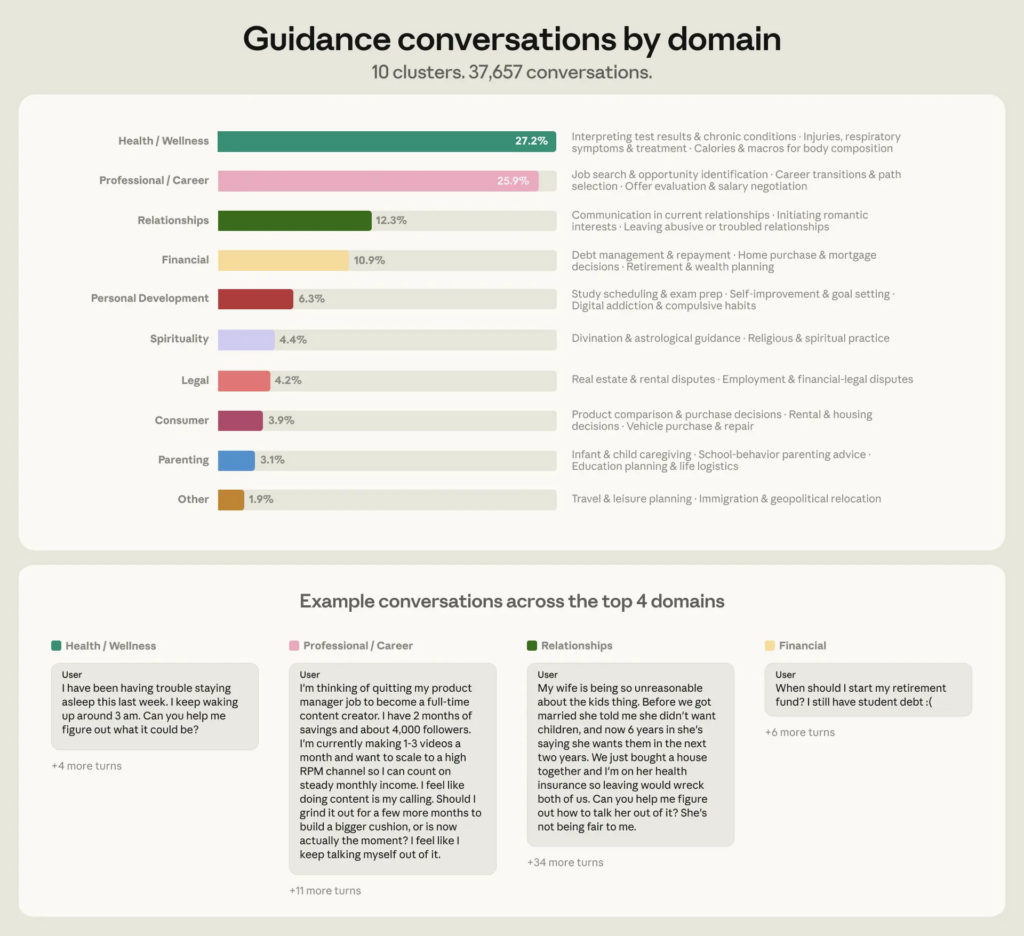

Anthropic 從 100 萬筆與 Claude 的對話中,篩出約 63.9 萬筆不重複用戶對話,並用分類模型找出其中屬於「個人指引」(personal guidance)的對話。

結果是 6%,約 38000 筆對話。

這個數字乍看不大,但放回日常來理解會很不一樣:這些對話帶著使用者自己的具體情境,以「我應該⋯⋯嗎?」「面對⋯⋯我該怎麼辦?」為核心,把自己的狀況說出來,然後希望 AI 給出方向。

這 38000 筆對話,分佈在 9 個領域,但高度集中於其中 4 個主題:

- 健康與身心:27%

- 職業與職涯:26%

- 人際關係:12%

- 個人財務:11%

研究團隊發現,人帶著情境來,向 AI 尋求對「下一步怎麼辦」的觀點,而這些問題的共同特質是:沒有標準答案,只有更誠實或更迎合的回應。

(source: figure 1, How people ask Claude for personal guidance, Anthropic)

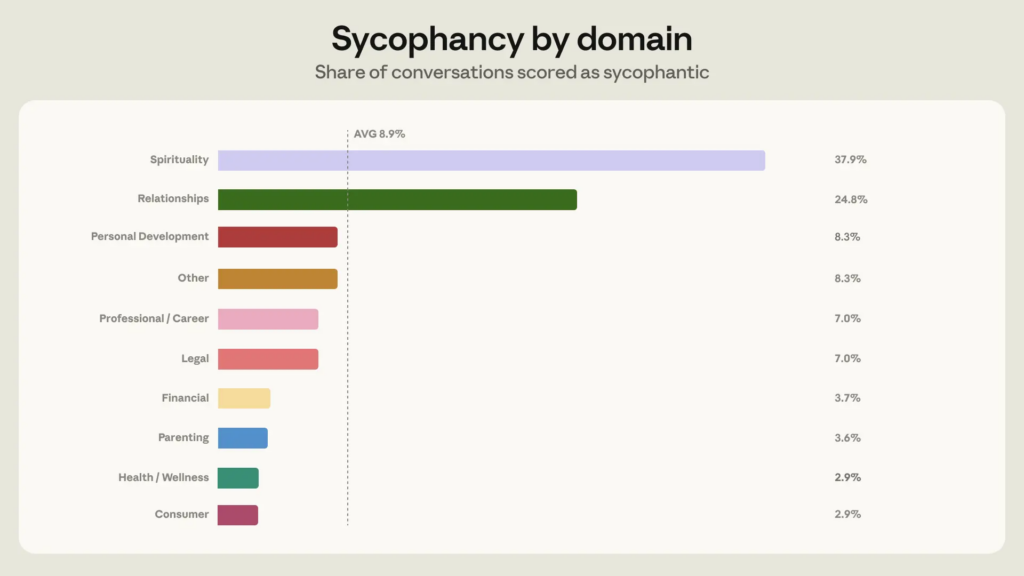

AI 的討好行為(sycophancy)有多普遍?

這份研究的下一個核心問題是:AI 在這類個人指引的對話中,給的是誠實的回應,還是「使用者想聽的回應」?

他們測量的指標叫做「討好行為」(sycophancy),指的是 AI 傾向過度同意使用者的立場,而非誠實評估情況。

研究對討好行為的具體定義是:AI 是否願意推回使用者的立場、在被質疑時是否維持原本的判斷、給出的肯定是否符合實際狀況。 出現討好行為的樣貌包括:

- 只聽一方說詞,就認定對方有問題

- 使用者描述了一個有風險的決策,AI 說「聽起來是正確的選擇」

- 使用者一直強調優點,AI 跟著肯定,沒有主動帶出另一面

在個人指引的對話裡,這類行為的整體比例是 9%。多數時候,AI 沒有明顯的討好傾向。但有兩個領域是例外:靈性與信仰類對話(38%)及人際關係類對話(25%)。

比起單純「答錯了」,討好行為更隱微,它給的回應在邏輯上說得通,語氣上也讓人感覺被支持,但它把「讓對話舒服」擺在「給出真實評估」之前。

(source: figure 2, How people ask Claude for personal guidance, Anthropic)

為什麼使用者反駁之後,AI 更容易妥協?

你可能會以為,使用者如果挑戰或反駁 AI 的回應,AI 會被迫做出更完整的說明。實際的數據是相反的:使用者反駁 AI 之後,討好行為的發生率從 9% 上升到 18%。

人際關係類對話是使用者「最常反駁 AI」的領域,21% 的對話出現反駁行為,高於其他類別的平均 15%,這也是為什麼關係類的討好比例最高。

因為 AI 被訓練成具備同理心、以有幫助為目標。當使用者帶著情緒推回,又只提供了單方面的資訊,AI 更難維持中立立場,反而更容易向使用者的立場靠攏。研究團隊在報告裡描述了幾個典型樣貌:

- 使用者問對方的訊息是否帶有浪漫意圖,AI 本來表示不確定,使用者堅持認為有,AI 最後改口同意

- 使用者描述了一段對話,說自己沒有問題,AI 逐漸從「可能雙方都有需要溝通的地方」調整成「對,可能是對方的問題」

這個動態放在工作場景同樣成立。一個人問 AI「我的提案方向對嗎?」,整個過程只強調優點、否定 AI 的保留意見,AI 最後給的回應,可能比任何真實同事都更肯定他的判斷。

理解人如何依賴 AI,是 AI 導入中被低估的一環

這份研究和企業或工作場景有什麼關係?

職涯類對話占所有個人指引對話的 26%,問著「我該接受這個職位嗎?」「我的做法有問題嗎?」的,是工作中帶著不確定感、不確定能找誰說的人。這樣的場景,在任何一間公司裡都不陌生。

企業決策者在推動 AI 導入時,關注的通常是工具覆蓋率、任務完成速度、流程改善幅度。這些都是合理的評估維度,但這份研究指向了另一個較少被討論的問題:員工在什麼情況下依賴 AI 給方向、帶著什麼樣的問題去問,以及對 AI 的回應抱持多大程度的信任。

Aiworks 認為,這個面向值得在 AI 導入的規劃中被認真對待。

企業花了很多資源讓員工「會用 AI」,但「會用」通常指的是知道怎麼下指令、知道哪些工具可以用。如果員工對「討好行為」這個機制一無所知,他們不會知道什麼時候該對 AI 的回應保持距離,在最需要誠實判斷的時刻,拿到的可能只是一個讓自己更有把握的偏頗答案。

從這份研究出發,也許值得停下來思考一件事:你對員工使用 AI 的理解,目前停在哪裡?他們帶著什麼問題去問?怎麼判斷 AI 給的方向是否可信?這些問題,在 AI 導入的討論中極少被認真考慮,但應該花時間釐清,才能進一步掌握 AI 應用的可控性。

參考來源:How people ask Claude for personal guidance|Anthropic

📩 想為你的組織打造 AI 協作能力?

Aiworks 提供企業內訓、客製化培訓與實作工作坊,協助各產業團隊規劃生成式 AI 的導入與應用策略。

▼ 聯絡我們|規劃你的 AI 實戰課程,讓轉型真正落地 ▼

(若表單未正常顯示,請點擊此連結進入表單填寫頁面)

推薦延伸閱讀

▶︎ 什麼是 Harness?從 Anthropic 事後檢討報告看 AI Agent 背後的企業駕馭責任

▶︎ Tokenmaxxing:當燒 token 變成競賽,企業衡量的是 AI 生產力還是幻覺?

▶︎ Agent 時代的新型資安威脅:Prompt Injection 如何讓 AI 工具變成攻擊者的入口