過去兩年,金融業強力推動 AI 導入,部分業務情境已進入規模化階段。

然而,CCAF(Cambridge Centre for Alternative Finance)與 Fii(Financial Innovation for Impact)發布的《2026 全球金融服務業 AI 報告》(The 2026 Global AI in Financial Services Report)卻指出:只有 14% 的金融機構認為透過 AI 轉型對組織策略與競爭優勢產生實質影響力。

採用率已經提升,影響力還沒有跟上,成爲金融業目前最關鍵的 AI 執行落差。

本篇 Aiworks 將透過這份橫跨 151 個市場、628 個組織,並由 BIS、IMF、WEF、World Bank Group 等機構合作支持的金融產業 AI 研究報告,拆解金融業 AI 採用的真實面貌,說明導入落差來自哪些結構性問題,風險版圖正在如何擴大,以及企業決策者現在應該優先建立哪些能力。

文章大綱

金融業 AI 採用率達 81%,僅 14% 進入實質轉型

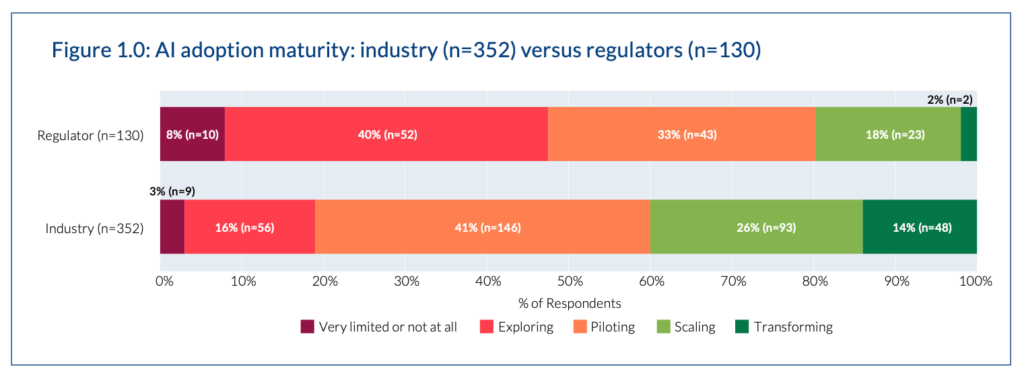

金融業的 AI 導入已經跨過早期試點階段。報告顯示,81% 的金融機構已導入 AI,40% 已進入規模化或轉型階段,也就是 AI 已經超出單一試點,開始在特定業務線或組織流程中擴大使用。

但只有 14% 的金融機構認為 AI 轉型對組織策略與競爭優勢產生實質影響力。

更棘手的是如何衡量 AI 帶來的實際效益:55% 的金融業者表示難以衡量 AI 部署的實際價值,監管機構的比例更高,達到 63%。在大型金融機構中,衡量困難更明顯,員工數超過 5,000 人的機構,有 76% 回報衡量 AI 價值存在相當困難。

對企業決策者來說,已經投入大量資源在 AI 導入,但許多組織還沒有建立能向董事會、主管層或業務單位說清楚成效的衡量或治理框架,因此 AI 導入就很容易停留在「有做、有用、有一些效率感」,卻難以累積成可被管理、可被複製、可被擴張的組織能力。

(source: Figure 6.0, The 2026 Global AI in Financial Services Report)

金融業 AI 規模化的三大核心阻礙:資料、人才、舊系統

報告中將 AI 導入的瓶頸集中在三個面向:資料品質、人才準備、舊系統架構。這三個問題牽動的是日常營運、風險控制與監管責任,對金融產業是不可忽視的挑戰。

資料品質與可用性:AI 落地的首要前置條件

根據 AI 服務供應商的回饋:

- 72% 指出,客戶端最大的挑戰是資料品質與完整性

- 46% 點名舊系統與資料孤島環境

- 41% 提到資料共享限制,包括隱私規範、資料主權與跨部門共享限制

模型能力再強,仍要有可用、可信、可追溯的資料支持才能有效運作。金融機構的資料常分散在不同業務系統、風控系統、客服系統與合規系統裡,格式、權限與更新頻率都不同。當資料本身無法穩定串接,AI 就很難從單點工具走向跨部門流程。

AI 人才缺口:跨域整合角色比技術人才更稀缺

41% 的金融機構把 AI 人才列為主要導入障礙,監管機構側則有 47% 回報人才問題。

技術人才短缺是一層問題,更大的挑戰是橫向角色不足。金融業需要的是能理解業務情境、資料限制、風險責任與 AI 應用方式的角色,這些人才要能把業務需求翻成可執行的 AI 工作流程,也要能把模型輸出帶回真實決策流程。這類角色缺位時,AI 很容易變成某個部門的工具試點,無法成為跨部門協作方式。

舊系統與架構複雜度:拉大傳統金融與金融科技的導入差距

傳統金融機構常有多層核心系統、地端部署、私有雲、安全控管與既有流程。報告指出,傳統金融機構較高比例仍依賴地端或私有雲部署,整合需求與安全要求也更嚴格,而這會直接拉高 AI 規模化的成本。

金融科技業者與傳統金融機構也因此拉開導入差距,在金融科技業者中,已進入規模化或轉型階段者佔 19%,傳統金融機構只有 6%。因為金融科技業者可以在較新的技術架構上快速試驗,傳統金融機構則要處理更多系統相依性、資料管線與風險控管。

資料、人才與舊系統是最容易被看見的阻礙,但更深層的阻力,來自風險疑慮如何改變 AI 導入的決策邊界。模型幻覺、資料隱私、可解釋性不足、第三方依賴與 Agentic AI 的責任歸屬,都會影響機構願意把哪些任務交給 AI、交到多深、由誰承擔最後責任。

金融業 AI 風險升級:從機構內部擴大到系統層級

金融業的 AI 風險已經超出單一模型或單一部門。報告中將風險拆成機構內部風險、營運風險、監管風險與系統性風險,讓企業決策者更容易看見治理壓力的來源。

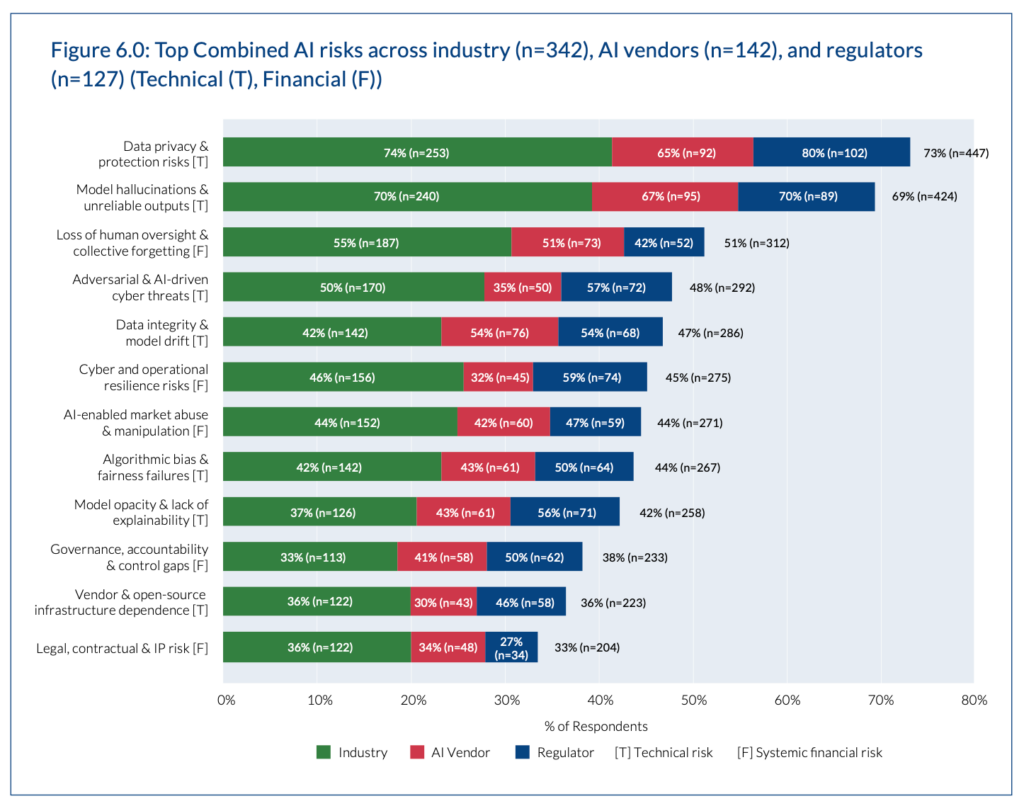

主要風險集中在以下幾個面向:

- 資料隱私與保護:74% 的金融機構與 80% 的監管機構把它列為主要疑慮。金融資料涉及客戶身份、交易紀錄、信用狀態與敏感財務資訊,任何資料處理錯誤都可能快速變成合規與信任問題。

- 模型幻覺與不可靠輸出:高達 70% 的受訪者把模型幻覺視為重大問題。這在信用審核、合規判斷、詐欺偵測或客戶通知中尤其敏感,因為金融機構不只需要正確輸出,也需要能追溯輸出如何產生、由誰核准、錯誤如何修正。

- 可解釋性落差:79% 的監管機構認為 AI 可解釋性對監理目標重要或非常重要,但只有 50% 的金融機構實際使用可解釋性方法。AI 服務供應商也回報,超過半數客戶缺乏使用可解釋性工具的能力。

- Agentic AI 的監管盲點:52% 的金融機構已在試點 Agentic AI 或更成熟階段,23% 已達規模化或轉型階段。報告直接把這個狀況稱為監管盲點,因為責任歸屬、數位身分、授權與可追溯性等治理問題尚未完整解決。

- 供應鏈集中風險:超過 80% 的受訪機構使用的基礎模型 (foundation models) 來自不超過 5 家供應商,雲端基礎設施也高度集中。金融業本身高度互聯,若大量機構依賴相同模型、相同雲端基礎設施與相似資料處理流程,單一供應鏈事件就可能跨機構放大。

(source: Figure 6.0, The 2026 Global AI in Financial Services Report)

目前已有具體監管能力建設開始出現。Project Noor 由 BIS Innovation Hub、香港金融管理局 (Hong Kong Monetary Authority, HKMA) 與英國 FCA(Financial Conduct Authority)合作,目標是開發監管用 AI 可解釋性工具,讓監管機構能獨立驗證金融機構 AI 模型的透明度、公平性與穩健性。BIS Innovation Hub 同期也進行 Project Aurora、Project Nadim 等計畫,分別涉及跨境洗錢偵測與詐欺模式共享。這些計畫給金融機構一個訊號:監管端正在補足 AI 監理能力。企業若等到規範完全明確才開始建立治理機制,調整成本會更高。

2030 展望:Agentic AI 規模化將重塑金融業治理框架

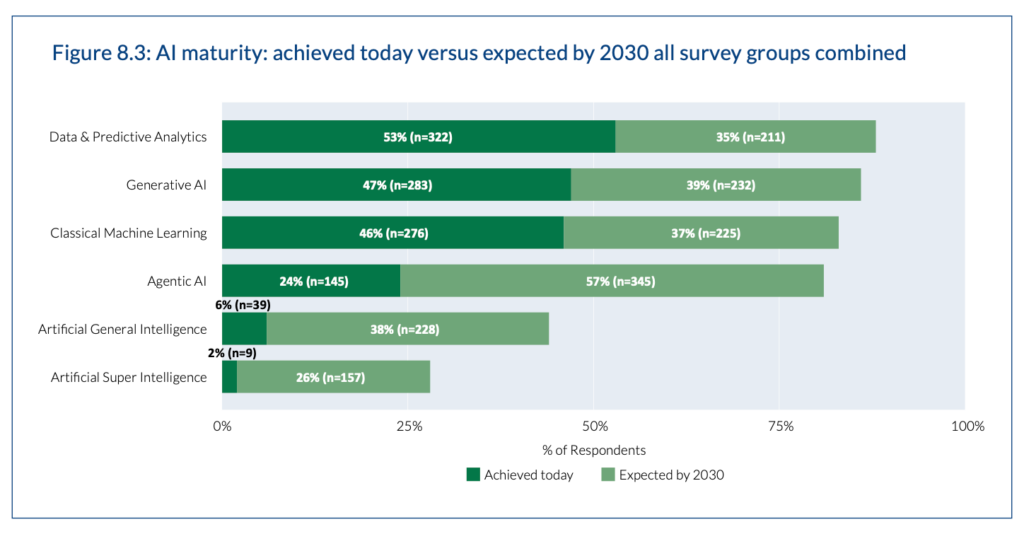

報告以 2030 年作為金融業 AI 發展的觀察時間點,指出未來五年 AI 能力將出現明顯變化Agentic AI 將會是成長幅度最大的項目。

這個變化會同時牽動幾個管理議題:

- Agentic AI 部署會明顯擴張:目前 24% 的受訪機構已實際部署自主性 AI Agent,也就是達到規模化或轉型階段,預期到 2030 年這個比例會升至 81%。而 Agentic AI 一旦進入金融流程,企業面對的問題會超出「員工用 AI 產生內容」或「系統提供建議」。它會牽涉流程觸發、權限管理、任務委派、例外處理與跨系統追蹤,每一項都回歸到治理設計。

- 競爭格局會被重新評估:2020 年時,近 50% 的受訪機構預期市場競爭格局維持現狀。到了 2026 年,這個比例已降到不到 10%。約半數業者預期某種程度的市場整合,約 20% 擔心出現贏家通吃的格局。能把 AI 導入資料、流程、風險與人員能力中的機構,可能在下一輪整合中取得更高效率與更快產品迭代速度。

- 監管協調仍有時間差:48% 的監管機構認為國際 AI 監管合作目前困難但有望改善,36% 認為進展穩健但緩慢,只有 9% 預期進一步碎片化。金融機構需要把這個時間差納入決策:業務部署正在前進,監管共識仍在形成,內部治理機制必須先跑起來。

- AI 價值衡量會成為下一階段投資條件:報告指出,獲利提升最明顯的功能集中在財務規劃與分析 (FP&A)、資產負債管理 (ALM)、產品創造與交易管理。企業若要持續取得 AI 投資資源,不能只靠使用人數、試點數量或工具覆蓋率,真正需要建立的是能連到營運效率、風險降低、決策速度、客戶體驗與財務影響的衡量方式。

(source: Figure 8.3, The 2026 Global AI in Financial Services Report)

金融業 AI 落地的五項優先行動:企業決策者指南

資料治理優先於模型選型,奠定 AI 落地基礎

資料孤島、資料品質與舊系統整合,是 AI 規模化部署的前置條件。模型選型可以影響體驗與成本,但資料基礎會決定 AI 能否進入真實流程。企業需要盤點哪些資料能被 AI 使用、哪些資料需要清理、哪些資料涉及權限與合規限制,以及跨部門資料共享該如何被管理。

於專案啟動階段同步建立 AI 價值衡量機制

55% 的金融機構目前難以衡量 AI 部署的實際價值。這件事不能等到部署完成後才補。每一個 AI 專案在啟動時,就應該定義它要改善哪個流程、降低哪種成本、縮短哪段時間、提升哪個決策品質,以及這些指標由誰負責追蹤。

於監管要求成形前,主動部署可解釋性與偏差監控

可解釋性已經是監管機構的明確關注點。金融機構應該先釐清哪些 AI 應用屬於高風險場景,哪些需要人類覆核,哪些需要輸出紀錄、偏差檢查與異常回報。這些設計越早放進流程,後續補強成本越低。

Agentic AI 部署前,明確界定人機責任邊界與授權機制

Agentic AI 會把 AI 從建議工具推進到流程參與者。企業要先定義 AI Agent 可以做什麼、不能做什麼、何時需要人類批准、哪些行為必須留下紀錄、錯誤發生時由誰處理。這些邊界如果沒有先建立,規模化部署後會變成流程與責任的混亂。

將 AI 導入定位為長期組織能力建設

AI 採用需連結到資料能力、治理能力、衡量能力與人員準備度,並持續投入。企業若只把 AI 當成單次採購,很難跨過執行落差。真正能拉開差距的,是把資料、治理、衡量與人才變成可累積的內部能力。

Aiworks 企業洞察:金融業 AI 競爭主軸轉向治理能力

金融業已經跑過 AI 採用率的第一輪競賽,真正的分歧正在移轉到治理能力。

第一,資料與系統能不能支撐 AI 進入真實流程?舊系統整合、資料品質、權限控管與跨部門資料共享,決定 AI 能不能從單點試驗走向規模化。

第二,Agentic AI 進入工作流程後,人機責任邊界能不能被清楚定義?誰設定權限、誰批准動作、哪些環節必須人工覆核、錯誤如何追蹤,這些問題會直接影響企業能否安全擴大 AI 使用範圍。

第三,可解釋性、偏差監控與風險回報能不能在監管要求完全成形前先建立起來?等待外部規範可以降低短期決策壓力,卻會增加未來調整成本。先建立內部機制的機構,會有更大的操作空間。

Aiworks 認為,金融業下一階段的 AI 競爭,重點會從「有沒有導入」轉向「能不能治理」。採用 AI 的速度仍然重要,但能否把 AI 變成可衡量、可監控、可負責、可擴張的組織能力,才會決定企業能不能跨過採用到執行之間的落差。

AI 導入的真正門檻,已經從工具選擇移到組織設計。金融機構若要在下一輪競爭中保有主動權,就需要把治理能力視為 AI 策略本身的一部分。

📩 想為你的組織打造 AI 協作能力?

Aiworks 提供企業內訓、客製化培訓與實作工作坊,協助各產業團隊規劃生成式 AI 的導入與應用策略。

▼ 聯絡我們|規劃你的 AI 實戰課程,讓轉型真正落地 ▼

(若表單未正常顯示,請點擊此連結進入表單填寫頁面)

推薦延伸閱讀

▶︎ AI 競爭重心從模型移向基礎設施:三大服務商的運算佈局與企業採用視角

▶︎ Tokenmaxxing:當燒 token 變成競賽,企業衡量的是 AI 生產力還是幻覺?

▶︎ 當 AI Agent 開始替你談判:從 Anthropic 實驗看企業導入前必須釐清的三個關鍵問題